Fábio Manoel França Lobato

Universidade Federal do Oeste do Pará

{[email protected]}

1 Introdução

É inegável a pervasividade da Inteligência Artificial (IA) em nossa sociedade. Um exemplo interessante trata sobre o uso da IA no combate a pandemia da COVID-19 [Bullock et al., 2020].

Neste trabalho, Bullock e colaboradores conduziram uma revisão da literatura categorizando estudos a nível molecular, clínico e social. Em todos os níveis o uso da IA foi evidenciado,

incluindo atividades como: descoberta de fármacos e desenvolvimento de vacinas; planejamento hospitalar; modelagem de perfis epidemiológicos; e difusão de desinformação em redes sociais, por exemplo.

Até nas artes a IA está presente. Um caso notório é da música “Hey Ya!” do grupo OutKast, sucesso nos anos 2000 descrito por [Roberts, 2020]. Nesta época, a indústria fonográfica começou a tomar decisões baseadas em dados para traçar estratégias a partir de previsões dos hábitos dos ouvintes. Em um breve resumo, um programa para detecção de sucesso apontou “Hey Ya!” como um hit em potencial, mas o seu lançamento não teve o impacto esperado logo de imediato. Recorreram então ao comportamento do consumidor e colocaram a música próxima entre outros hits do momento, resultado: “Hey Ya!” viralizou.

Este é apenas um dos inúmeros exemplos de aplicação de IA nas artes. O advento da aprendizagem profunda possibilitou a construção de sistemas capazes de reconhecer o estilo artístico em pinturas de forma mais acurada [Lecoutre et al., 2017]. A geração de conteúdo também é possível, por exemplo, o Deepart customiza imagens a partir de dois inputs: 1) uma

imagem a ser customizada; 2) um estilo de pintura [Mao et al., 2017]. A geração de músicas de acordo com determinados estilos a partir de sistemas baseados em IA, também, já é possível [Briot et al., 2017].

Tais possibilidades trazem à baila questionamentos acerca da propriedade intelectual de tais obras. Neste ensejo, a quem pertence o direito autoral de uma obra produzida a partir de um sistema baseado em Inteligência Artificial? Ao criador da IA? A empresa/corporação que subsidiou o desenvolvimento deste sistema? Ou a própria IA enquanto entidade criadora?

Este ensaio visa contribuir com uma visão tecnicista sobre a discussão da aplicabilidade de direito autoral a partir de obras produzidas por IA. O restante do manuscrito encontra-se organizado como segue. Na Seção 2 apresento um breve contexto da IA, destacando a sua evolução conceitual. Na Seção 3 trato sobre a fronteira de IA e a sua relação com a chamada “IA Forte”. O processo de construção de um modelo baseado em IA é discutido na Seção 4. Por fim, algumas considerações finais são feitas na Seção 5.

2 O que é a Inteligência Artificial?

A despeito da visão unicionista e ficcional do grande público, onde o robô é uma entidade de IA única, dotado de consciência, capaz de tomar decisões racionais em nível humano, a IA de fronteira aponta para outra direção. Antes de dissertar sobre, é necessário entender os motivos pelos quais esta visão está tão arraigada. Russel Stuard e Peter Norvig destacam uma declaração de Hebert Simon em 1957:

“Não é meu objetivo surpreendê-los ou chocá-los, mas o modo mais simples de resumir tudo isso é dizer que agora existem no mundo máquinas que pensam, aprendem e criam. Além disso, sua capacidade de realizar essas atividades está crescendo rapidamente até o ponto — em um futuro visível — no qual a variedade de problemas com que elas poderão lidar será correspondente à variedade de problemas com os quais lida a mente humana.” [Russell and Norvig, 2002]

Prêmio Turing (1975) e Prêmio Nobel (1978), Hebert Simon contribuiu notavelmente para teorias de decisão em organizações baseadas em satisfação e com racionalidade limitada. Um de seus trabalhos seminais, o livro “The sciences of the artificial” influenciou fortemente a área chamada de “Design theory”, que trouxe bases científicas ao projeto de sistemas artificiais – não somente baseadas em IA, mas também, “para todos os campos (do conhecimento) que criam artefatos para desenvolver tarefas ou cumprir objetivos e funções”(1) [Simon, 1996] – Tradução e grifo do autor.

A perspectiva de que a construção de artefatos, também chamados de sistemas artificiais – e, reforço, não necessariamente baseados em IA, pode vir acompanhado da construção de conhecimento, revolucionou alguns campos, dentre os quais a própria IA, que teve um impulso quando passou a adotar com firmeza o método científico, onde as hipóteses passaram a ser submetidas a experimentos rigorosamente projetados [Cohen, 1995].

Além da adoção de testes estatísticos e avaliação rigorosa de desempenho, o próprio projeto dos sistemas inteligentes passou a ter métodos apropriados. Destaco aqui o processo de descoberta de conhecimentos em bases de dados, por seu termo em língua inglesa Knowledge Discovery in Databases (KDD) proposto no trabalho seminal de Fayyad, Piatesky-Shapiro e Smyth em 1997 [Fayyad et al., 1996] e uma versão mais genérica bastante utilizada em Sistemas de informação que é o Design Science Research (DSR) [Hevner and Chatterjee, 2010, Gregor and Hevner, 2013]. Mais a frente irei dissertar sobre tais metodologias e contextualizá-las ao projeto de sistemas inteligentes.

Mas, o que é então a Inteligência Artificial? Empresto aqui algumas definições organizadas por [Russell and Norvig, 2002]:

- “[Automatização de] atividades que associamos ao pensamento humano, atividades como a tomada de decisões, a resolução de problemas, o aprendizado…” [Bellman, 1978]

- “A arte de criar máquinas que executam funções que exigem inteligência quando executadas por pessoas.” [Kurzweil et al., 1990]

- “O estudo de como os computadores podem fazer tarefas que hoje são melhor desempenhadas pelas pessoas.” [Rich and Knight, 1991]

- “O estudo das computações que tornam possível perceber, raciocinar e agir.” [Patrick, 1992]

- “Inteligência Computacional é o estudo do projeto de agentes inteligentes.” [Poole, 1993]

Organizei os conceitos em ordem cronológica para evidenciar o distanciamento do pensamento humano e inteligência (definições 1 e 2), para a execução de atividades (definição 3) e posteriormente para o projeto de agentes inteligentes (definições 4 e 5). Essa mudança adveio, dentre outros fatores, as limitações técnicas – tanto do entendimento do pensamento humano, quanto da capacidade de modelagem de tal processo. Este redirecionamento das pesquisas em IA nos leva para um questionamento importante, a “IA forte” realmente existe?

3 A “IA forte” existe?

A influência do pensamento do próprio Alan Turing, considerado o pai da IA, de Hebert Simon e outros, consolidou o conceito de uma “Inteligência Artificial Geral” (IAG). De fato, a IAG foi o objetivo basilar dos primórdios da IA, onde acreditava-se que a inteligência de uma máquina poderia executar com sucesso qualquer tarefa intelectual que um ser humano pode, também chamada de “IA Forte” ou “IA Completa” [Baum, 2017]. Também é possível definir a IAG como o campo de pesquisa que estuda máquinas capazes de executar uma ação (ou decisão) superior ao intelecto humano [Gill, 2016].

Para entender o conceito de “IA Forte”, precisamos do conceito de Teste de Turing. Em sua mais recente obra, Stuart Russel afirma:

“(…) ele (Turing) propôs um teste operacional para inteligência, chamado de jogo da imitação, que mais tarde (numa forma simplificada ficaria conhecido como teste de Turing. O teste avalia o comportamento da máquina – especificamente, sua capacidade de enganar um interrogador humano e levá-lo a acreditar que ela é humana.” [Russell, 2019]

O mais importante, a máquina estaria dotada de consciência, ou seja, ela precisaria estar ciente de seus próprios estados mentais e suas ações [Russell and Norvig, 2002]. Em [Russell, 2019], o autor complementa:

“Turing esperava direcionar a discussão para a questão de saber se uma máquina poderia se comportar de determinada maneira; e, em caso positivo – se fosse capaz, por exemplo, de discursar razoavelmente sobre os sonetos de Shakespeare e seu significado -, o ceticismo sobre a IA se tornaria insustentável. (…) Na verdade, Turing escreveu ’Não poderiam as máquinas executar coisas descritas como pensamento, mas muito diferente do que um ser humano faz?’. Outro motivo para não ver o teste como uma definição de IA é que é terrível trabalhar com essa definição, e é por isso que os mais importantes pesquisadores de IA quase não se esforçam para passar no teste de Turing.”

Avaliando a fronteira em IA, percebe-se que os esforços mais próximos de uma “consciência” estão em um campo chamado “Explainable Artificial Intelligence” (XAI) ou em conceitos correlatos como IA interpretável ou IA responsável [Adadi and Berrada, 2018]. Tal campo de pesquisa surgiu a partir de pressões sociais e, consequentemente, de agências regulatórias, de que o sistema baseado em IA fornecesse não somente a decisão mais provável (predição) quanto também uma explicação – quais motivos o levaram a tomar tal decisão.

O livro Weapons of math destruction: how big data increases inequality and threatens democracy apresenta um bom resumo dos motivos pelos quais a XAI é tão necessária, dentre os quais, destaco a escalabilidade, o viés inerente aos dados rotulados com decisões humanas prévias (já enviesados) e o potencial impacto catastrófico de tais sistemas [O’neil, 2016]. O documentário Coded Bias (2), disponível na plataforma de streamingNetflix também é um material rico de informações sobre este tema. Encerro esta seção com a ponderação feita por [Russell, 2019]:

“O teste de Turing não tem utilidade para a IA porque é uma definição simples e altamente condicional: depende das características imensamente complicadas e basicamente desconhecidas da mente humana, que nascem tanto da biologia como da cultura.”

4 O processo de construção de um modelo baseado em IA

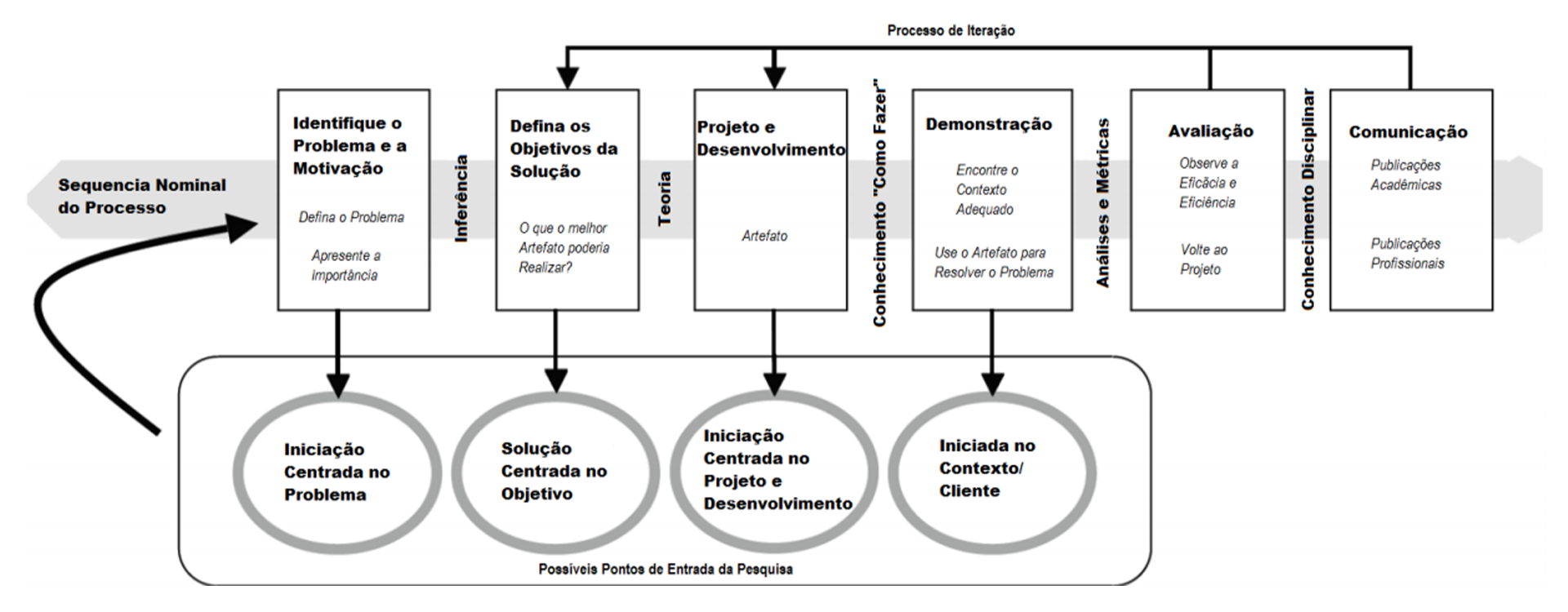

Se o Teste de Turing não é o objetivo dos pesquisadores de IA, o que move este campo? Para entender, retomo o Design Science Research e o processo de KDD, descritos por [Hevner and Chatterjee, 2010] e [Fayyad et al., 1996] respectivamente. O DSR é um processo de seis etapas encadeadas. As fases são: i) identificação do problema e motivação; ii) definição dos objetivos da solução; iii) Projeto e desenvolvimento da solução (etapa de design); iv) demonstração que o artefato resolve uma ou mais instâncias do problema; v) avaliação da eficiência do artefato; vi) comunicação dos achados. Importante notar que o início do processo pode ocorrer em uma das quatro etapas iniciais, não tendo que iniciar obrigatoriamente da primeira. O desenho esquemático do DSR pode ser visto na Figura 1.

Figura 1: Etapas da metodologia DSR. Fonte: Adaptado de [Hevner and Chatterjee, 2010]

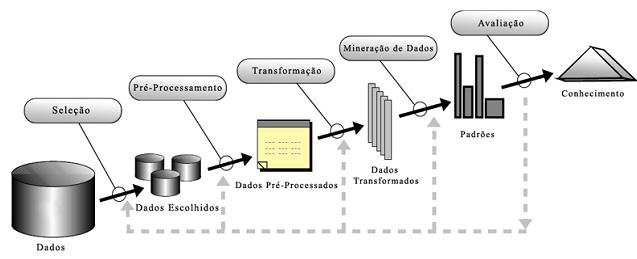

Figura 2: Etapas do KDD. Fonte: Extraído de [Lira et al., 2016]

O interessante do DSR é que ele permite a construção de conhecimento antes, durante e após a construção do artefato, além de deixar claro os objetivos (utilidade) e desempenho (avaliação) dos constructos. Por isso esta metodologia é tão utilizada em sistemas de informação que visam a inovação tecnológica[Gregor and Hevner, 2013].

É possível notar uma clara similaridade entre o DSR e o processo de KDD, cujas etapas encontram-se descritas na Figura 2. Enquanto o KDD é mais centrado nos dados, desde a seleção das bases até o uso do seu conhecimento – geralmente incorporado em um sistema de suporte à decisão (e.g.: análise de crédito bancário [Addo et al., 2018]; predição de suicídio baseado em dados de mídias sociais [Roy et al., 2020] etc).

Assim como os exemplos mencionados na Introdução, o agente inteligente é projetado para um objetivo. É uma visão utilitarista e que guia o processo de avaliação do próprio modelo. Tendo como exemplo a análise de crédito bancário, a medida de desempenho adotada pode ser a taxa de perdas nos empréstimos concedidos, ou ainda, no exemplo da predição de suicídio, a taxa de acertos pelo número total de exemplos, medida chamada de acurácia. A definição das medidas de desempenho tem impacto crucial na utilidade do modelo-padrão, tal como evidenciado no supramencionado documentário Coded Bias.

Um processo padrão que vêm sendo aceito pela comunidade de IA é o CRoss Industry Standard Process for Data Mining (CRISP-DM). A descrição completa do processo pode ser encontrada em [Wirth and Hipp, 2000]. Este processo pode ser entendido como uma evolução do KDD. A primeira etapa do CRISP-DM consiste no entendimento do domínio de aplicação (semelhante as duas primeiras etapas do DSR), as duas etapas subsequentes referem-se ao entendimento e a preparação dos dados. As três últimas etapas são de construção do modelo, o que envolve escolha de algoritmos, parametrização e treinamento; avaliação do modelo considerando o domínio de aplicação; e o deployment, que pode ser entendido como o pleno uso do modelo.

A literatura de IA apresenta uma vasta gama de exemplos do uso destes processos em diversos domínios de aplicação. A apresentação dos três processos teve um intuito de evidenciar o papel humano na qualidade dos modelos, sobretudo quanto ao entendimento e preparação dos dados. Estima-se que cerca de 80% de todo o tempo do processo seja dedicado ao entendimento e preparação dos dados (3).

A aprendizagem profunda ganhou notoriedade por justamente alimentar os algoritmos com os dados brutos, dispensando ou minimizando o tempo gasto na preparação dos dados, reduzindo a intervenção humana no processo – cabe ao modelo aprender a representação adequada dos dados [LeCun et al., 2015]. Destaco ainda o surgimento de uma área chamada automated machine learning, mais conhecida pelo acrônimo automl [He et al., 2021].

De toda a sorte, os avanços na área não apontam na direção de ausência de intervenção humana. Apesar do caso notório do AlphaZero, que por meio do paradigma de aprendizagem por reforço foi capaz de criar seus próprios dados de partidas e refinar o modelo [Silver et al., 2018], a aplicação em mundo real de tal abordagem ainda parece incipiente – dado a natureza do ambiente dos agentes inteligentes – que não possui regras estáticas e ambiente controlado tal como um tabuleiro de xadrez ou de go.

Em resumo, a vasta maioria das aplicações envolvendo IA ainda é humano-dependente em todo o seu processo, sobretudo na definição das medidas de desempenho e na validação dos constructos – incluindo os projetos envolvendo a criação de artefatos passíveis de proteção por direitos autorais como imagens digitais, música, poemas etc. Portanto, quais aspectos estão relacionados à criação de uma obra por um sistema baseado em IA? Tento responder este questionamento, relacionando alguns aspectos pertinentes a criação de artefatos a partir de sistemas baseados em IA com o direito autoral, ressalto, a partir de uma visão tecnicista.

5 Considerações finais

Ao longo deste ensaio busquei lançar luz ao conceito de inteligência artificial que representasse tanto o estado da arte quanto o estado da prática. Evidenciei que operacionalização de uma IA consciente e senciente ainda está restrita ao universo ficcional, e que o processo de criação de modelos-padrão – isto é, que atendam à um propósito específico (e.g.: criação de vídeos realísticos como deepfake ou geração de imagens estilizadas como DeepArt) dependem da mobilização de uma grande quantidade de especialistas, como analistas de banco de dados, estatísticos, programadores, analistas de desempenho etc. Na subseção a seguir apresento os principais aspectos correlatos e levanto alguns questionamentos relacionado a proteção por direito autoral. Em seguida, traço um paralelo com outras aplicações que são tuteladas por direito autoral, encerrando com um posicionamento sobre a IA enquanto autora.

Aspectos relacionados à sistemas baseados em IA

- Componente humano: como visto, o componente humano é de extrema importância para o sucesso de um projeto de IA. É dele que vem a compreensão do domínio de aplicação que permitirá definir a(s) medida(s) de desempenho do agente inteligente, além da escolha do(s) algoritmo(s) e suas parametrizações. Negligenciar o papel do especialista humano, tanto que a política nacional de inteligência artificial do Chile (4), lançada em 2021, coloca o desenvolvimento de talentos como o primeiro eixo dos fatores habilitantes de tal ação. Cabe lembrar que a IA não criaria uma obra por livre e espontânea vontade, ele é um sistema reativo, ou seja, precisa de um input humano para que isso ocorra. Então, questiono, como podem os desenvolvedores e analistas serem deixados de lado do direito autoral advindo de uma obra produzida por IA?

- Plataforma de desenvolvimento (software): uso aqui o termo plataforma ao invés de ambiente, pois este termo é mais amplo, abarcando não somente as ferramentas utilizadas para desenvolver a aplicação como as Integrated Development Environment (IDE), mas também os frameworks que encapsulam os algoritmos de IA. Exemplos de frameworks utilizados para aprendizagem profunda incluem Keras (5) e Tensorflow (6), por exemplo. Tais plataformas podem ser protegidas por direito autoral, por meio do registro de programa de computador). Em alguns países, a proteção também pode se dar por meio de patente de software. Nota-se que algumas das ferramentas são open-source. O que abre o questionamento, como fica a relação do licenciamento destas ferramentas e o esquema de proteção de obras construídas a partir delas?

- Infraestrutura computacional (hardware): os métodos/algoritmos de IA que permitem a geração de obras passíveis de proteção por direitos autorais como músicas, desenhos e textos, requerem alto poder de processamento. Dentre tais métodos, destaco as Generative Adversarial Networks (GANs) [Creswell et al., 2018] e a Long Short-Term Memory (LSTM) [Mao et al., 2018]. Apesar do barateamento do custo do hardware, aceleração por meio de General-Purpose computing on Graphics Processing Units (GPGPUS) e até mesmo uso de infraestrutura sob demanda como o Google Colab (7), permitindo que desenvolvedores independentes consigam rodar seus códigos a baixo custo, usualmente existem empresas/companias/universidades que subsidiam times de desenvolvimento e provêm a infraestrutura necessária. Dessa forma, pondera-se que a proteção do tipo work for hire também seja ventilada em tais casos;

- Dados: algoritmos baseados em aprendizagem profunda são conhecidos por requererem uma quantidade massiva de dados a fim de dispensar o processo de preparação destes. Ora, as bases de dados podem ser protegidas por direito autoral, o que levanta um questionamento, como fica o direito autoral das obras que foram baseadas em uma base de dados protegida?

Paralelos com outras formas de proteção e implicações

Alguns dos questionamentos levantados na subseção anterior já norteiam algumas possibilidades para tutelar as obras produzidas por um sistema baseado em IA. Importante destacar que já existem artefatos criados parcialmente por sistemas baseados em IA e que são tutelados pelo direito autoral, como por exemplo, a topologia de circuitos integrados, protegido pela modalidade de propriedade intelectual Sui generis de acordo com a Lei 11.484, de 31 de Maio de 2007. Digo que a topologia de circuitos integrados é criada parcialmente pois a IA não é capaz de criá-la sem o input, supervisão e validação de especialistas humanos.

Outro paralelo que pode ser feito é com a produção audiovisual, considerando os inúmeros atores necessários para a construção de um sistema baseado em IA, conforme apresentado na Seção anterior. O Prof. Dr. Marcos Wachowicz apresenta no canal do Instituto Observatório do Direito Autoral no YouTube um bom contexto sobre a aplicabilidade do direito autoral à produção audiovisual (8).

Argumento contra a atribuição de autoria plena ao agente dotado de IA perguntando: Caberia uma penalidade a IA em caso de infração, como plágio? Isso é impensável. Desligá-la não garantiria que uma cópia do modelo fosse utilizada em outro computador. Comparo a IA a um cão, quando este ataca um ser humano – a legislação prevê que o dono do animal possa ser penalizado pela atitude do cão. Por analogia, a punição caberia aos construtores do agente inteligente (conjunto de pessoas ou corporações) – isso teria um efeito regulatório mais eficaz que o “desligamento da máquina”.

Encerro este ensaio enaltecendo a necessidade de mais discussões sobre este tema tão atual e relevante economicamente, tanto que a comunidade científica já iniciou estudos sobre aspectos estéticos e percepções públicas acerca de criações artísticas puramente humanas e mediadas por inteligência artificial [Hong and Curran, 2019]. Ressalto ainda que a regulação precisa considerar os aspectos técnicos, e ainda, que reflitam os interesses sociais e econômicos, a fim de assegurar os investimentos na área por meio da exploração da propriedade intelectual.

Agradecimentos

Este trabalho foi parcialmente financiado pelo ConselhoNacional de Desenvolvimento Científico e Tecnológico (CNPq) – DT-308334/2020-5.

Notes

1Original: “All fields that create designs to perform tasks or fulfill goals and functions.”

2https://www.netflix.com/br/title/81328723 acessado em 30 de janeiro de 2022.

3https://www.forbes.com/sites/gilpress/2016/03/23/data-preparation-most-time-consuming-least-enjoyable-datascience-task-survey-says/?sh=73b421726f63 acessado em 31 de janeiro de 2022.

4https://minciencia.gob.cl/areas-de-trabajo/inteligencia-artificial/politica-nacional-de-inteligencia-artificial/ acessado em 21 de dezembro de 2021.

5https://keras.io/ acessado em 31 de janeiro de 2022

6https://www.tensorflow.org/ acessado em 31 de janeiro de 2022

7https://research.google.com/colaboratory/intl/pt-BR/faq.html acessado em 31 de janeiro de 2022

8https://youtu.be/b0lWzkfVmu4 acessado em 31 de janeiro de 2022.

Referências

[Adadi and Berrada, 2018] Adadi, A. and Berrada, M. (2018). Peeking inside the black-box: a survey on explainable artificial intelligence (xai). IEEE access, 6:52138–52160.

[Addo et al., 2018] Addo, P. M., Guegan, D., and Hassani, B. (2018). Credit risk analysis using machine and deep learning models. Risks, 6(2):38.

[Baum, 2017] Baum, S. (2017). A survey of artificial general intelligence projects for ethics, risk, and policy. Global Catastrophic Risk Institute Working Paper, pages 17–1.

[Bellman, 1978] Bellman, R. (1978). An introduction to artificial intelligence: can computer

think? Boyd & Fraser Publishing Company.

[Briot et al., 2017] Briot, J.-P., Hadjeres, G., and Pachet, F.-D. (2017). Deep learning techniques for music generation–a survey. arXiv preprint arXiv:1709.01620.

[Bullock et al., 2020] Bullock, J., Luccioni, A., Pham, K. H., Lam, C. S. N., and Luengo-Oroz, M. (2020). Mapping the landscape of artificial intelligence applications against covid-19. Journal of Artificial Intelligence Research, 69:807–845.

[Cohen, 1995] Cohen, P. R. (1995). Empirical methods for artificial intelligence, volume 139. MIT press Cambridge, MA.

[Creswell et al., 2018] Creswell, A., White, T., Dumoulin, V., Arulkumaran, K., Sengupta, B., and Bharath, A. A. (2018). Generative adversarial networks: An overview. IEEE Signal Processing Magazine, 35(1):53–65.

[Fayyad et al., 1996] Fayyad, U., Piatetsky-Shapiro, G., and Smyth, P. (1996). From data mining to knowledge discovery in databases. AI magazine, 17(3):37–37.

[Gill, 2016] Gill, K. S. (2016). Artificial super intelligence: beyond rhetoric.

[Gregor and Hevner, 2013] Gregor, S. and Hevner, A. R. (2013). Positioning and presenting design science research for maximum impact. MIS quarterly, pages 337–355.

[He et al., 2021] He, X., Zhao, K., and Chu, X. (2021). Automl: Asurvey of the state-of-the-art. Knowledge-Based Systems, 212:106622.

[Hevner and Chatterjee, 2010] Hevner, A. and Chatterjee, S. (2010). Design science research in information systems. In Design research in information systems, pages 9–22. Springer.

[Hong and Curran, 2019] Hong, J.-W. and Curran, N. M. (2019). Artificial intelligence, artists, and art: attitudes toward artwork produced by humans vs. artificial intelligence. ACMTransactions on Multimedia Computing, Communications, and Applications (TOMM), 15(2s):1–16.

[Kurzweil et al., 1990] Kurzweil, R., Richter, R., Kurzweil, R., and Schneider, M. L. (1990). The age of intelligent machines, volume 580. MIT press Cambridge. of the 25th ACM international conference on Multimedia, pages 1183–1191.

[Mao et al., 2018] Mao, H. H., Shin, T., and Cottrell, G. (2018). Deepj: Style-specific music generation. In 2018 IEEE 12th International Conference on Semantic Computing (ICSC), pages 377–382. IEEE.

[O’neil, 2016] O’neil, C. (2016). Weapons of math destruction: How big data increases inequality and threatens democracy. Crown.

[Patrick, 1992] Patrick, H. (1992). Winston. artificial intelligence.

[Poole, 1993] Poole, D. (1993). Probabilistic horn abduction and bayesian networks. Artificial intelligence, 64(1):81–129.

[Rich and Knight, 1991] Rich, E. and Knight, K. (1991). Artificial intelligence second edition, 1991.

[Roberts, 2020] Roberts, L. (2020). The power of data: My journey into the field.

[Roy et al., 2020] Roy, A., Nikolitch, K., McGinn, R., Jinah, S., Klement, W., and Kaminsky, Z. A. (2020). A machine learning approach predicts future risk to suicidal ideation from social media data. NPJ digital medicine, 3(1):1–12.

[Russell, 2019] Russell, S. (2019). Human compatible: Artificial intelligence and the problem of control. Penguin.

[Russell and Norvig, 2002] Russell, S. and Norvig, P. (2002). Artificial intelligence: a modern approach. Pearson.

[Silver et al., 2018] Silver, D., Hubert, T., Schrittwieser, J., Antonoglou, I., Lai, M., Guez, A., Lanctot, M., Sifre, L., Kumaran, D., Graepel, T., et al. (2018). A general reinforcement learning algorithm that masters chess, shogi, and go through self-play. Science, 362(6419):1140–1144.

[Simon, 1996] Simon, H. A. (1996). The sciences of the artificial. MIT press.

[Wirth and Hipp, 2000] Wirth, R. and Hipp, J. (2000). Crisp-dm: Towards a standard process model for data mining. In Proceedings of the 4th international conference on the practical applications of knowledge discovery and data mining, volume 1, pages 29–39. Springer-Verlag London, UK.

0 comentários